7 月 9 日消息,阿里云通義千問開源了兩款語音基座模型 SenseVoice(用于語音識(shí)別)和 CosyVoice(用于語音生成)。

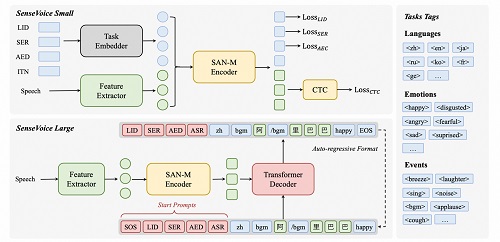

SenseVoice 專注于高精度多語言語音識(shí)別、情感辨識(shí)和音頻事件檢測,有以下特點(diǎn):

多語言識(shí)別:采用超過 40 萬小時(shí)數(shù)據(jù)訓(xùn)練,支持超過 50 種語言,識(shí)別效果上優(yōu)于 Whisper 模型

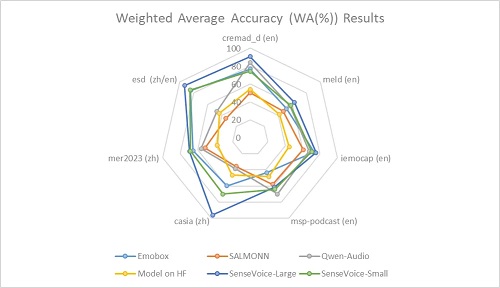

富文本識(shí)別:具備優(yōu)秀的情感識(shí)別,能夠在測試數(shù)據(jù)上達(dá)到和超過目前最佳情感識(shí)別模型的效果;支持聲音事件檢測能力,支持音樂、掌聲、笑聲、哭聲、咳嗽、噴嚏等多種常見人機(jī)交互事件進(jìn)行檢測

高效推理: SenseVoice-Small 模型采用非自回歸端到端框架,推理延遲極低,10s 音頻推理僅耗時(shí) 70ms,15 倍優(yōu)于 Whisper-Large

微調(diào)定制:具備便捷的微調(diào)腳本與策略,方便用戶根據(jù)業(yè)務(wù)場景修復(fù)長尾樣本問題

服務(wù)部署:具有完整的服務(wù)部署鏈路,支持多并發(fā)請求,支持的客戶端語言有 python、c++、html、java 與 c#等

與開源情感識(shí)別模型進(jìn)行對比,SenseVoice-Large 模型可以在幾乎所有數(shù)據(jù)上都達(dá)到了最佳效果,而 SenseVoice-Small 模型同樣可以在多數(shù)數(shù)據(jù)集上取得超越其他開源模型的效果。

CosyVoice 模型同樣支持多語言、音色和情感控制,該模型在多語言語音、零樣本語音生成、跨語言語音克隆和指令跟隨等功能方面表現(xiàn)出色。