2024 年 7 月 22 日凌晨,xAI 創(chuàng)始人 Elon Musk 在推特上正式宣布,在凌晨 4:20 分正式啟動了世界上最強的 AI 訓(xùn)練集群。

這個訓(xùn)練集群建設(shè)在美國田納西州孟菲斯市,集合了 10 萬個液冷 H100 芯片。

然而,這在當(dāng)?shù)貐s引發(fā)了居民們的抗議和不滿。

這樣巨大的 AI 訓(xùn)練集群每天會消耗 100 萬加侖的水和 150 兆瓦的電力,因此也是引發(fā)了當(dāng)?shù)丨h(huán)保人士的擔(dān)心和抗議。

隨著萬卡集群,甚至十萬卡集群成為科技巨頭們訓(xùn)練 AI 大模型的標(biāo)配,這樣的巨型數(shù)據(jù)中心到底意味著什么?

消耗電力好理解,那為什么會消耗如此多的水呢?冷卻系統(tǒng)與供電系統(tǒng)等關(guān)鍵基礎(chǔ)設(shè)施是如何運作的?目前數(shù)據(jù)中心的主計算芯片開始從 CPU 轉(zhuǎn)向 GPU,這會帶來如何的變革?

可能大家對 CPU、GPU 這類計算芯片了解較多,卻很少會關(guān)注配套的基礎(chǔ)設(shè)施。

但事實上,它們就像冰山藏在水下的部分一樣,不僅是整個數(shù)據(jù)中心的支柱,還是至關(guān)重要的安全樞紐。

我們來揭秘一下萬卡集群的數(shù)據(jù)中心到底是如何運作的,也非常榮幸邀請了專注于數(shù)據(jù)中心基礎(chǔ)設(shè)施的公司維諦技術(shù)的多位專家一起來探討,AI 爆發(fā)給數(shù)據(jù)中心的基礎(chǔ)設(shè)施帶來的挑戰(zhàn)與機遇。

01 AI 時代數(shù)據(jù)中心面臨的挑戰(zhàn)

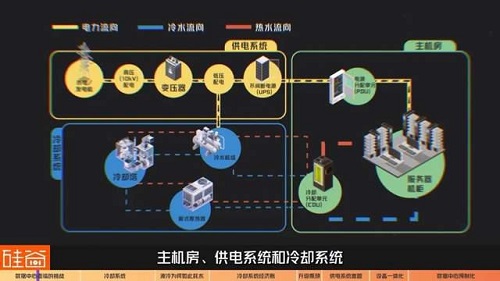

首先,我們先簡單了解下,數(shù)據(jù)中心的組成結(jié)構(gòu)。

從物理結(jié)構(gòu)上來看,數(shù)據(jù)中心會劃分成三個系統(tǒng),主機房、供電系統(tǒng)和冷卻系統(tǒng)。

如果咱們把數(shù)據(jù)中心類比成一支軍隊,你看這主機房陳列的一排排機柜,像不像前線征戰(zhàn)的士兵,它們承擔(dān)著整個數(shù)據(jù)中心的核心功能——運算。

而冷卻與供電系統(tǒng)則是軍隊后方的保障機構(gòu)。冷卻系統(tǒng)負(fù)責(zé)保障士兵的健康與安全,供電系統(tǒng)負(fù)責(zé)糧草的運送與分配。

此外還有綜合管理系統(tǒng)來維護兵器等等,它們就像數(shù)據(jù)中心的 " 兵部尚書 ",雖然不在一線征戰(zhàn),卻起到了關(guān)鍵作用。

如今一些數(shù)據(jù)中心開始由通用計算轉(zhuǎn)向?qū)S糜嬎悖渲幸?AI 為主的數(shù)據(jù)中心被稱為 " 智算數(shù)據(jù)中心 ",主力芯片從 CPU 變成了 GPU,這也將對所有基礎(chǔ)設(shè)施帶來巨大的挑戰(zhàn)。

顧華

維諦技術(shù)市場營銷與產(chǎn)品應(yīng)用高級總監(jiān):

因為傳統(tǒng)的 CPU 其實過去十多年的時間一直在采用的 X86 的結(jié)構(gòu),它 CPU 的功耗,包括服務(wù)器的功耗都相對比較標(biāo)準(zhǔn)和恒定,所以我們在過去的近十多年的時間,看到數(shù)據(jù)中心的平均的機柜的功率密度,大概一直在 3~5 千瓦左右。

但是現(xiàn)在隨著 GPU 的采用,AI 模型的推理和訓(xùn)練,需要集中大量的 GPU 來進行并行的浮點運算,需要通過集群的方式,通過軟件互聯(lián)通信在非常小的空間里面集中大量的 GPU。

這使得 GPU 的服務(wù)器,包括單機柜的功率密度會迅速的提高。所以我們也看到機柜的功率密度從過去的 5 千瓦,現(xiàn)在迅速的提升到了 10 千瓦、 20 千瓦、 40 千瓦,甚至 80 千瓦、100 千瓦以上。

智算機柜功率密度的提升對基礎(chǔ)設(shè)施來說,我覺得主要有四大方面的挑戰(zhàn)。

首先是給散熱能力帶來的挑戰(zhàn),第二個方面是給高效的能源供應(yīng)帶來的挑戰(zhàn),第三個是占地面積,第四是快速的部署。

所以,GPU 芯片的迅速更新迭代給數(shù)據(jù)中心配套設(shè)施帶來了這四大挑戰(zhàn)。如何應(yīng)對這四個問題,我們先來看看冷卻系統(tǒng),為什么它會如此耗水?

02 冷卻系統(tǒng)

Chapter 2.1 冷卻系統(tǒng)的重要性

電子器件運行時會產(chǎn)生熱量,而芯片對熱量尤其敏感,如果過熱,輕則觸發(fā)芯片的自我保護機制,降低運行頻率,重則導(dǎo)致服務(wù)器故障,業(yè)務(wù)中斷,甚至燒毀硬件。

隨著數(shù)據(jù)中心的功率密度越來越高,這時如果冷卻系統(tǒng)發(fā)生故障,留給維護人員的反應(yīng)時間,可能只有一兩分鐘。

王超

維諦技術(shù)熱管理解決方案部高級經(jīng)理:

如果單機柜到了 10 千瓦,按照我們過去的仿真經(jīng)驗,可能很快,一兩分鐘,(環(huán)境)就能到 30 多度甚至 40 度,那就宕機了。

因此,芯片算力的升級也直接帶來了對數(shù)據(jù)中心冷卻系統(tǒng)的升級需求。我們在《搶電、圈地、對賭,深聊科技巨頭的千億美元 AI 能源大戰(zhàn)》那期文章里也講過,隨著功率密度的提升,廠商們開始轉(zhuǎn)向液冷方案。

而恰恰是這個液冷,導(dǎo)致了不少環(huán)保人士抵制。

除了開頭說的 xAI 訓(xùn)練集群外,2023 年烏拉圭民眾也聯(lián)合抗議谷歌建設(shè)數(shù)據(jù)中心,還有新墨西哥州的農(nóng)民抗議 Meta 數(shù)據(jù)中心遷入。

大家抵制的原因之一就是,這些數(shù)據(jù)中心耗水太多,甚至加劇了當(dāng)?shù)氐母珊登闆r。

那為什么液冷會消耗如此多的水呢?

Chapter 2.2 液冷為何如此耗水

在回答這個問題前,我們需要簡單科普下冷卻系統(tǒng)的結(jié)構(gòu)。目前冷卻系統(tǒng)主要分為兩個大類,風(fēng)冷與液冷。

我們先來聊聊風(fēng)冷。如果你進入過數(shù)據(jù)中心,那第一感覺應(yīng)該是:太吵了!這個噪音就來自于機柜中用于給芯片降溫的風(fēng)扇。

風(fēng)扇的作用是將芯片的熱量散發(fā)到空氣中,但如果熱量全部堆積在空氣中,也會降低散熱效果,所以還需要空調(diào)對空氣降溫。

空調(diào)也分為很多種,我們這里就不一一舉例了。

顯而易見的是,空氣的熱交換效率較低,在功率密度不斷提升下,必須采用效率更高的散熱介質(zhì),那就是液體。

液冷散熱的原理就是通過水的蒸發(fā)潛熱帶走芯片的熱量,液冷散熱也分為很多種,目前全球主流的兩類是冷板液冷和浸沒液冷。

當(dāng)然在國內(nèi)還有一種是噴淋液冷技術(shù)。噴淋也是一個比較創(chuàng)新的技術(shù),但這個技術(shù)目前還是受到了一定的限制,所以不是很多。

冷板液冷是讓冷板與芯片緊密貼合,讓芯片熱量傳導(dǎo)至冷板中的冷卻液,并將冷卻液中的熱量運輸至后端冷卻。

而浸沒液冷是將整個主板都浸沒在特定液體中,但對于目前主流的 GPU 設(shè)備來說,浸沒液冷卻不太適用。

維諦技術(shù)熱管理解決方案部高級經(jīng)理:?

因為所有 GPU 它都是還是按照冷板液冷這種規(guī)格來開發(fā)的,所以不太適配浸沒。

冷卻系統(tǒng)會分為一次側(cè)和二次側(cè),一次側(cè)是將整體熱量散走,并與二次側(cè)的冷卻分發(fā)單元(Cooling Distribution Units,簡稱 CDU)來交換熱量。

通常提到的液冷散熱,都是指二次側(cè),由 CDU 將冷水分配到各個機柜中。而當(dāng)前的液冷散熱系統(tǒng)一次側(cè)大部分也是水冷方式,最終在室外通過水的顯熱交換和潛熱交換帶走全部熱量。

顯熱交換是水在加熱或冷卻過程中,會吸收或釋放的熱量,水的狀態(tài)不變。

而潛熱交換就是水在相變過程中,如蒸發(fā)、凝結(jié)、融化、凝固時,吸收或釋放的熱量,而溫度保持不變。

就像咱們天氣熱時,如果給房間放一盆水,水溫慢慢升高,這就是顯熱交換;同時水會慢慢蒸發(fā),這就是潛熱交換,兩種交換共同進行,使得水盆上方的空氣溫度降低。

前面我們說到環(huán)保人士抵制 AI 數(shù)據(jù)中心,就是因為萬卡集群的 AI 數(shù)據(jù)中心,浪費的水實在太多了。

這其實就回到那個規(guī)模效應(yīng)了,如果說咱們只是建一兩個數(shù)據(jù)中心,比如就是像 20 兆瓦,或者甚至即使到 100 兆瓦都沒事。但是如果進一步擴大,那個耗水量是非常巨大的,可能會對當(dāng)?shù)氐牡叵滤Y源有一定的影響,可以肯定一定會存在數(shù)據(jù)中心和人搶水的這個問題。

你可能想問,就算水蒸發(fā)了,那不是還會變成雨降下來嗎?為什么會被稱為 " 浪費 " 呢?我們分兩個方面來說。

首先,水蒸發(fā)后變成云,飄到哪兒降落就不好說了,數(shù)據(jù)中心就像個抽水機,把當(dāng)?shù)氐乃樽吆笏偷搅似渌胤剑瑢τ谠窘涤炅康偷牡貐^(qū),加劇了干旱情況。

其次,數(shù)據(jù)中心對水的質(zhì)量要求也不低,但高質(zhì)量的水蒸發(fā)后,如果降落在污染地或海面,這些水很難再利用了。

同時,使用高質(zhì)量的水,也意味著數(shù)據(jù)中心要和居民搶水,甚至可能造成民用水不夠的情況。

那為什么一定要用高質(zhì)量的水呢?

水如果蒸發(fā),它就會跟制冷設(shè)備的一些部件會有接觸,不管是水滴還是水霧,它到制冷設(shè)備上面,如果水質(zhì)不太好,比如酸堿度不太好,偏酸偏堿都可能會導(dǎo)致腐蝕。如果鈣鎂離子的含量比較多,就像咱們家里燒開水一樣,那可能水垢就會附著在表面上。

一旦水垢附著在換熱設(shè)備的表面,帶來的影響就是換熱設(shè)備的效率會下降。本來我是 200 千瓦的散熱量,但是因為水溝問題,可能會導(dǎo)致它衰減到 80%,甚至更低,那帶來的就是冷量可能不夠這一類的問題。

有報道稱,每個數(shù)據(jù)中心平均每天要消耗 100 萬到 500 萬加侖的水,比如開頭提到的 xAI 萬卡集群,每天消耗 100 萬加侖的水,可供 3000 多戶家庭使用一天。

而 GPT-3 在訓(xùn)練期間消耗了 700 萬噸水,后續(xù)的推理階段,每回答 20 個問題,就相當(dāng)于倒掉了一瓶 500 毫升的礦泉水。

NPJ 的一份名為《數(shù)據(jù)中心用水調(diào)查》報告顯示,數(shù)據(jù)中心耗水來源 58% 是飲用水,這其中還存在耗水不透明度的問題,長此以往甚至?xí)斐蓺夂蝻L(fēng)險。

所以也難怪 AI 數(shù)據(jù)中心會遭到抵制了。

同時,也有企業(yè)做過海底數(shù)據(jù)中心,如此一來不就解決了耗水問題嗎?但很遺憾,這就涉及到冷卻系統(tǒng)面臨的另一大挑戰(zhàn),經(jīng)濟賬的問題了。

Chapter 2.3 冷卻系統(tǒng)的經(jīng)濟賬

海底數(shù)據(jù)中心就是把服務(wù)器放置在殼體內(nèi)并沉到海水里,因為海水的溫度較低,可以直接為殼體降溫,而且不需要額外補充機械能。

聽上去是個既節(jié)能又環(huán)保的方案,但維諦的專家告訴我們,這將對技術(shù)提出更高的要求。

因為沉到海水里邊,整個數(shù)據(jù)中心的殼體、包括一些光纜還有電纜之類的,它都要能下海,其實提出了更高的要求。

更高的技術(shù)要求,就意味著企業(yè)需要在研發(fā)上投入更多,但長期來看,這確實是一個創(chuàng)新的解決方案。

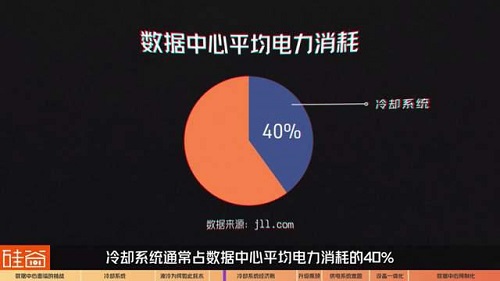

除了技術(shù)難題外,冷卻系統(tǒng)的用電也一直居高不下。有數(shù)據(jù)顯示,冷卻系統(tǒng)通常占數(shù)據(jù)中心平均電力消耗的 40%,不少巨頭都在努力降低冷卻系統(tǒng)的能源消耗,但搞不好反而會弄巧成拙。

有論文研究稱,數(shù)據(jù)中心每將送風(fēng)溫度提高 1 ° C,可以降低大約 2-5% 的制冷功率,因此數(shù)據(jù)中心開始呈現(xiàn)把冷卻系統(tǒng)溫度從 75 ℉(約 23.9 ℃)提高到 85 ℉(約 29.4 ℃)的趨勢,連谷歌也采取了這樣的做法。

但這個做法還挺危險的,這相當(dāng)于你設(shè)置的溫度,距離數(shù)據(jù)中心能承受最高溫度的緩沖區(qū)間縮窄了,反倒會導(dǎo)致系統(tǒng)性風(fēng)險。

比如,2021 年,新加坡一家數(shù)據(jù)中心運營商為了節(jié)省冷卻成本,將溫度提高到危險的臨界水平,結(jié)果導(dǎo)致數(shù)據(jù)中心服務(wù)器大面積故障,這種情況持續(xù)了近一周,真是得不償失。

同時,這篇論文也發(fā)出了警告:數(shù)據(jù)中心受到熱攻擊的原因之一,是因為采用了激進的冷卻策略,也就是系統(tǒng)溫度設(shè)置的太高,減少了冗余度。

所以如何讓冷卻系統(tǒng)更節(jié)能,成為了 AI 時代的挑戰(zhàn)之一。

維諦技術(shù)的專家告訴我們,要降低冷卻系統(tǒng)能耗,主要分為三大方向。

現(xiàn)在從節(jié)能角度來講,其實是可以分為三大方向。一個是從風(fēng)側(cè)來做自然冷來做節(jié)能,然后另外的話就是水側(cè)自然冷,還有就是氟側(cè)自然冷。

所謂的 " 自然冷 "(Free-Cooling),是指利用室外的低溫冷源,來給室內(nèi)降溫,達(dá)到降低能耗的一種技術(shù)方法。

想象一下冬天我們悶在房間里非常熱,如果打開窗戶讓室外的冷空氣進入,房間就涼快了,這就是自然冷。

而風(fēng)側(cè)自然冷,就是在窗戶邊放一些風(fēng)扇向房間吹風(fēng),加速室外冷空氣進入。

水側(cè)自然冷和氟側(cè)自然冷,則是將導(dǎo)體替換為了水和氟。

風(fēng)側(cè)自然冷它是受地理條件的限制比較大,因為它是會把新風(fēng)引到機房里來,對空氣質(zhì)量之類有一定的要求,其實就是即使做新風(fēng)也是會結(jié)合一些機械冷的。從我們來講,我們還是更專注于水側(cè)自然冷和氟側(cè)自然冷。

氟側(cè)自然冷就是我們常規(guī)的風(fēng)冷空調(diào)這個系統(tǒng),在溫度相對來說比較低,以及冬季的時候,來通過氟泵工作來利用室外自然冷源,那這會就不需要開壓縮機了,壓縮機的功耗就是整個系統(tǒng)里邊制冷功耗最大的部分,那如果可以在一部分時間里邊把壓縮機替換成氟泵,因為氟泵的功率是很低的,那當(dāng)然可以大大的節(jié)約能耗。

水側(cè)自然冷,做節(jié)能就是通過室外的一些蒸發(fā)之類的,把它的那個冷的能力間接的帶到室內(nèi)來。

風(fēng)側(cè)自然冷受到地理限制較大,水側(cè)自然冷蒸發(fā)的水太多,所以目前既省電又省水的方案,就是氟側(cè)自然冷。

氟側(cè)自然冷它就是一個無水的智能解決方案,天然的它就不需要水,它是靠氟泵、靠冷媒來實現(xiàn)自然冷的,不需要靠水的蒸發(fā)。

但這種方式就對技術(shù)提出了很大挑戰(zhàn),需要長期的積累經(jīng)驗,才能控制好整套系統(tǒng)。

怎么才能更好的控制,讓氟泵的工作時長更長一點點,讓氟泵和壓縮機的切換能夠更加的穩(wěn)定、更少的波動、然后讓它更節(jié)能。它的難度是比做水側(cè)自然冷是要更難的,所以最大的難點就還是在于技術(shù)儲備。

除了節(jié)能環(huán)保外,如今數(shù)據(jù)中心還面臨著芯片升級的挑戰(zhàn)。

我們之前的文章中有提到,英偉達(dá)新出的 Blackwell 芯片,由于功耗上升,老舊的數(shù)據(jù)中心難以直接部署,甚至一些公司由于業(yè)務(wù)轉(zhuǎn)型,需要將以 CPU 為主的計算設(shè)備,升級到以 GPU 為主,如何改造成了當(dāng)下的難題。

Chapter 2.4 數(shù)據(jù)中心如何升級?

在 AI 來之前,數(shù)據(jù)中心的分類其實都是以風(fēng)冷為主的,那它的單機柜功率密度才 5~10 千瓦,而且其實 10 千瓦的都不是很多了,主要是 5~6 千瓦這樣的為主。那現(xiàn)在我要升級智算,首先要把風(fēng)冷設(shè)備的散熱量加夠,然后再去額外的再去補充液冷部分。

既然冷卻系統(tǒng)可以升級,為什么還有些企業(yè)會選擇花很多資金重建數(shù)據(jù)中心呢?這就不得不說到,舊機房升級的瓶頸了。

對于制冷它主要就是空間的問題,一般情況下,從我們當(dāng)前的設(shè)計經(jīng)驗來看,制冷設(shè)備的空間往往可能是夠的。因為原先的單機柜 6 千瓦,現(xiàn)在單機柜 40 千瓦,那單機柜的功率密度提升了 6 倍還多,原先 6 個機柜解決的問題,現(xiàn)在只需要一個機柜。

行業(yè)里邊有一個說法,就是數(shù)據(jù)中心的盡頭其實是電力,所以咱們在擴容的時候,往往首先要考慮的還是電力的問題。

為什么電力是制約數(shù)據(jù)中心升級的因素?AI 爆發(fā)又給供電系統(tǒng)帶來了哪些挑戰(zhàn)呢?接下來我們聊聊供電系統(tǒng)。

03 供電系統(tǒng)

Chapter 3.1 AI 給供電系統(tǒng)帶來的挑戰(zhàn)

我們在 AI 電力爭奪戰(zhàn)那期文章里講過,AI 數(shù)據(jù)中心帶來了大量電能消耗,未來將給電網(wǎng)帶來供應(yīng)缺口,其實不止是外部的電網(wǎng),AI 數(shù)據(jù)中心內(nèi)部的供電也同樣面臨巨大壓力,其中很大的因素就在于占地面積。

趙呈濤

維諦技術(shù) ACP 解決方案部高級經(jīng)理:

因為整個的功率密度提升,供配電和 IT 機房的占比出現(xiàn)了很大的偏差,占地面積成為了一個很大的挑戰(zhàn)。

正是因為這些難點,成為了老舊數(shù)據(jù)中心升級困難的原因,其中最為棘手的就是占地問題。

在解析這個問題前,為了便于大家理解,我們先簡單介紹下供電系統(tǒng)的結(jié)構(gòu)。

Chapter 3.2 供電系統(tǒng)結(jié)構(gòu)及占地問題

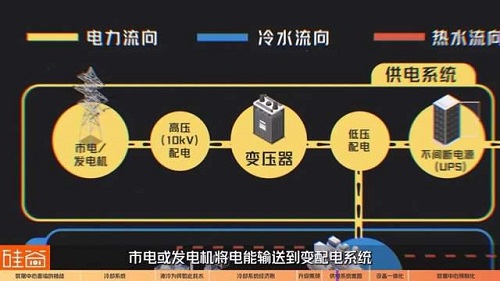

供電系統(tǒng)的結(jié)構(gòu)主要分為四個層級:市電或發(fā)電機將電能輸送到變配電系統(tǒng),變配電系統(tǒng)會給冷卻系統(tǒng)、不間斷電源(Uninterruptible Power Supply,即 UPS)供電,UPS 再將電能送到主機房的電源分配單元(Power Distribution Unit,即 PDU),由 PDU 給每個機柜分配電能。

其中發(fā)電機是為了在市電發(fā)生故障時有應(yīng)急的電力輸入,但發(fā)電機啟動需要一定時間,而 UPS 包含了大容量電池,能保證服務(wù)器繼續(xù)運行 5 到 15 分鐘,為發(fā)電機啟動爭取時間。

當(dāng)然,供電系統(tǒng)還會根據(jù)市電線路數(shù)和冗余結(jié)構(gòu)的不同,分為 DR 架構(gòu)、RR 架構(gòu)、2N 架構(gòu),這里我們就不多贅述了。

那回到占地面積的問題,由于服務(wù)器功耗增加后,需要額外的供電設(shè)備,但是,供電設(shè)備實在太占地了。

從傳統(tǒng)的數(shù)據(jù)中心建設(shè)來看,它會有傳統(tǒng)的中壓室、低壓室、電力室、電池室等等,這些傳統(tǒng)的產(chǎn)品都會通過線來做連接,這些物理連接由于它是分散于各個廠家的產(chǎn)品,它的標(biāo)準(zhǔn)的制式、標(biāo)準(zhǔn)的體積都不是很融合,另外一個它們的整個的部署的物理距離,中間的一般都是都會有一些間隙。

所以有限的空間成了制約老舊數(shù)據(jù)中心升級的痛點,想發(fā)展 AI,重建數(shù)據(jù)中心成了更好的選擇。

但數(shù)據(jù)中心的設(shè)計壽命有 20 到 30 年,GPU 換代一般是 3~5 年,總不能隔幾年就重建一次吧,為此行業(yè)發(fā)展出了新的方向,那就是設(shè)備一體化。

Chapter 3.3 設(shè)備一體化與效率提升

我們針對占地面積的問題,推出了交流直流供配電一體化的電力模組,就像我們傳統(tǒng)的組裝式的電腦,現(xiàn)在變成了一體機是一樣的,我們通過將 UPS、供配電、變壓器、補償、饋電柜多個產(chǎn)品融合為一體,提供了一個工程產(chǎn)品化的一個產(chǎn)品,這樣可以將我們占地面積減少至少 30%。

當(dāng)然我們還有一個新型的解決方案,我們的供配電電力模組,采用背靠背的這種方式,通過上送風(fēng),這樣的話我們可以把傳統(tǒng)的電力層面積再縮小 50%。

縮小其他設(shè)備的占地面積不光有利于老舊數(shù)據(jù)中心的升級,新的數(shù)據(jù)中心也能帶來更高的經(jīng)濟效益,因為騰出來的空間就可以多擺點計算用的機柜、多一些算力,縮短模型的訓(xùn)練與推理時間。

除了縮小設(shè)備占地外,供電系統(tǒng)的另一個趨勢是提升電能傳輸效率。

眾所周知,每個設(shè)備都有電阻,電能在一層層設(shè)備的轉(zhuǎn)換中,總會伴隨著能量損失,如此一來為了滿足服務(wù)器機柜的電能需求,前端的供配電設(shè)備需要留有更多冗余、占據(jù)更大面積。

而提升傳輸效率后,不僅能減少設(shè)備的數(shù)量,還能降低數(shù)據(jù)中心的能耗,達(dá)到節(jié)能減排的效果。

那該從哪些方面來提升效率呢?

第一,UPS 我們采用了碳化硅的產(chǎn)品線,將整個的效率提升了很多。第二,我們采用了 SCB 的多晶合金的變壓器,第三通過以傳統(tǒng)的線纜方式改用銅牌的方式來連接,進一步降低了線路的損耗來提升它整體的效率。

為了提升末端配電的負(fù)載,我們推出了 1000 安培的小母線,這樣服務(wù)器未來可以擴容 100 千瓦、 150 千瓦。

最后,我們來聊聊顧華提到的第四個挑戰(zhàn),快速部署。有意思的是,行業(yè)為此竟然呈現(xiàn)出了 " 預(yù)制化 " 的趨勢,這能行得通嗎?

04 建設(shè)周期與快速部署

如今全球的 AI 戰(zhàn)正打的火熱,急劇增長的算力需求促使著各大公司新建 AI 數(shù)據(jù)中心,這就對整行業(yè)提出了建設(shè)速度的要求,畢竟 AI 數(shù)據(jù)中心早一天上線,就能帶來更多經(jīng)濟效益。

大家也在紛紛嘗試創(chuàng)新的解決方案,譬如 " 木質(zhì)數(shù)據(jù)中心 ",用木材作為關(guān)鍵結(jié)構(gòu)部件,來建設(shè)數(shù)據(jù)中心。

難道他們就不怕遇到地震、臺風(fēng)或者火災(zāi)啥的,把整個數(shù)據(jù)中心都弄沒了嗎?

其實盡管木質(zhì)數(shù)據(jù)中心聽上去是個非常激進的概念,但早在 2019 年就有公司就建成并投入使用了。

他們使用的也并不是那種直接從樹上鋸下的木板,而是名為正交膠合木(Cross-Laminated Timber,簡稱 CLT)的建筑材料。

這種材料具有極高的強度和均勻性,直接作為承重墻板或者樓板使用都沒問題,同時它還有耐火的特性,英國就有棟名為 Stadthaus 的九層樓公寓,采用了 CLT 材料建成。

木質(zhì)材料不僅能滿足環(huán)保的要求,還能通過預(yù)制化,將整體的建設(shè)速度,加快 40%~80%。

當(dāng)然,數(shù)據(jù)中心的建設(shè)不光是外部建筑,還有內(nèi)部的基礎(chǔ)設(shè)施需要定制。而現(xiàn)在,冷卻系統(tǒng)與供電設(shè)備也走向了預(yù)制化的道路。

雷愛民

維諦技術(shù)綜合解決方案架構(gòu)部總監(jiān):

現(xiàn)在的智算中心,客戶可能需要在 6 個月之內(nèi)建設(shè)好,這也是傳統(tǒng)建造方式的最快完工時間,而維諦的 360AI 智算解決方案,可以協(xié)助客戶縮小 50% 左右的時間。

我們在海外和一些算力公司、互聯(lián)網(wǎng)公司有合作,會根據(jù)它需要的算力,來定制全套的預(yù)制化基礎(chǔ)設(shè)施。就是說已經(jīng)提前把數(shù)據(jù)中心的基礎(chǔ)設(shè)施配套好了,同時對里面的供電、制冷、軟件,甚至工程的材料的預(yù)制化,都進行了詳細(xì)的部署。

將設(shè)備由定制改為預(yù)制,就能大幅節(jié)省工程時間,但這其中又會存在匹配性的問題。

不同的客戶他確實有很大的需求上的差別,比如政府和金融項目,金融客戶他最在乎的就高可靠性,他對創(chuàng)新、綠色持穩(wěn)健的態(tài)度,但是對互聯(lián)網(wǎng)公司來說,他在乎的就是創(chuàng)新性、成本、部署速度。所以說在這兩種客戶之間,我們提供的是差異化的服務(wù)、差異化的方案和服務(wù)。

不同的數(shù)據(jù)中心,都有自己獨特的需求,如果失去了 " 定制 " 這個環(huán)節(jié),是否意味著預(yù)制化的設(shè)備難以大量鋪開呢?

專家給我們解釋道,所謂的預(yù)制化,其實是預(yù)制了各個部件的模塊,在一個統(tǒng)一的平臺下,可以將這些模塊按需求來組裝,這樣就能滿足不同的客戶。

維諦技術(shù)綜合解決方案架構(gòu)部總監(jiān):?

維諦實際上它在長期的發(fā)展和實踐里面,它形成了很多標(biāo)準(zhǔn)化的組件,所以說當(dāng)一項新的需求來臨的時候,我們可能優(yōu)先去選擇,在這個積木庫里面,去提取一些適合我們這個新的場景的一些部件和組件,這樣就可以高效率的搭建出一個適應(yīng)客戶新的需要的,這樣的一個產(chǎn)品類型。

打個比方,就像我們買來的樂高積木,其實是很多通用的小塊,它既可以拼成汽車,也能拼成飛機。

雖然我們常說,AI 的飛躍源自芯片的積累,然而,為芯片運行打下基石的,是基礎(chǔ)設(shè)施的技術(shù)進步,它們?nèi)缤瑹o形的 " 兵部尚書 ",在幕后默默支持和調(diào)控著前線士兵的作戰(zhàn)行動,讓 AI 大模型訓(xùn)練順利推進。

就像之前提到的,士兵的作戰(zhàn)效率在提升,那么兵部尚書的水平也要相對提高,這對整個 AI 芯片的上下游市場都提出了更高的要求,是挑戰(zhàn)也是機遇。

隨著更高能力、更多參數(shù)以及更大 AI 模型的投入訓(xùn)練,也許我們會看到數(shù)據(jù)中心更快的升級迭代,有更多的技術(shù)創(chuàng)新來支持 AI 大模型的技術(shù)大戰(zhàn)。