6月29日消息,阿里云近日公布了其專門為訓練大型語言模型(LLM)的超大數據傳輸而創建的以太網網絡設計,并且已在實際業務中使用了 8 個月。

阿里云之所以選擇以太網是出于避免過度依賴少數供應商和利用“整個以太網聯盟的力量實現更快發展”的愿望。這一決定似乎也順應了越來越多廠商開始支持以太網,逃離英偉達NVlink在云端AI互聯上的壟斷。

阿里巴巴的以太網網絡計劃是阿里云高級工程師、網絡研究研究員翟恩南(Ennan Zhai)的GitHub 頁面上披露的。翟恩南發布了一篇論文,該論文將在 8 月份的 SIGCOMM 會議上發表,該會議是美國計算機協會數據通信特別興趣小組的年度聚會。

這篇題為《阿里巴巴 HPN:用于大型語言模型訓練的數據中心網絡》的論文開篇指出,流量云計算流量“……會產生數百萬個小流量(例如低于 10Gbit/秒)”,而大語言模型訓練“會在每個主機上產生少量周期性、突發性的流量(例如 400Gbit/秒)”。

等價多路徑路由是一種常用的通過多條路徑將數據包發送到單個目的地的方法,但它容易出現哈希極化,這種現象會導致負載平衡困難并顯著減少可用帶寬。

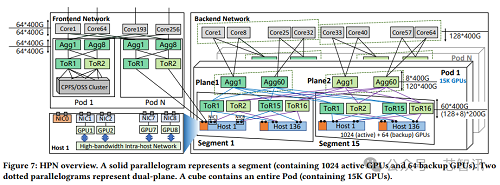

阿里云的自制替代方案名為“高性能網絡”(HPN),“通過減少 ECMP 的出現來避免哈希極化,同時也大大減少了路徑選擇的搜索空間,從而使我們能夠精確選擇能夠容納大流量的網絡路徑。”

HPN 還解決了 GPU 在訓練大型語言模型時需要同步工作的事實,這使得 AI 基礎設施對單點故障很敏感——尤其是機架頂部交換機。

因此,阿里巴巴的網絡設計使用了一對交換機——但不是交換機供應商建議的堆疊配置。

堆滿了卡片

論文解釋稱,阿里云用于大型語言模型訓練的每臺主機都包含 8 個 GPU 和 9 個網絡接口卡 (NIC),每個卡都有一對 200GB/秒的端口。其中一個 NIC 負責處理“后端網絡”上的日常流量。

前端網絡允許主機中的每個 GPU 通過以 400-900GB/秒(雙向)運行的主機內網絡直接與其他 GPU 通信。每個 NIC 服務于單個 GPU(阿里云稱之為“軌道”),這種安排使每個加速器以“專用的 400Gb/秒 RDMA 網絡吞吐量運行,總帶寬為 3.2Tb/秒”。

論文指出:“這樣的設計旨在最大限度地利用 GPU 的 PCIe 功能(PCIe Gen5×16),從而將網絡發送/接收容量推向極限。”NIC 上的每個端口都連接到不同的機架頂部交換機,以避免單點故障。

阿里云表示傾向于使用以太網,這對于 AMD、博通、思科、谷歌、HPE、英特爾、Meta 和微軟來說無疑是個好消息。所有這些供應商最近都加入了Ultra Accelerator Link (UALink)聯盟,旨在挑戰英偉達的 NVlink 網絡業務。

英特爾和 AMD 表示,該聯盟以及Ultra Ethernet等其他先進網絡項目代表了一種更好的 AI 工作負載網絡化方式,因為從長遠來看,開放標準總是會獲勝,因為它們使創新變得更加容易。

不過,盡管阿里云的 NPM 設計基于以太網,但它仍然有使用英偉達的技術。這家英偉達的 NVlink 用于主機內網絡(帶寬比主機間網絡更大),并且還采用了“軌道優化”設計方法,即每個網絡接口卡都連接到不同的機架頂部交換機組。

阿里巴巴的單芯片交換機統治地位

這篇論文還多次提到阿里云的架頂式交換機中有一個“51.2Tb/秒以太網單芯片交換機(于 2023 年初首次發布)”。有兩款設備符合這一描述:博通的Tomahawk ASIC于 2023 年 3 月出貨,思科的G200于同年 6 月上市。提到“2023 年初”似乎表明阿里云選擇了博通的解決方案。

無論阿里巴巴交換機的內部情況如何,該論文表明中國云計算公司偏愛單芯片驅動的交換機。

論文指出:“目前已經出現了支持更高帶寬容量的多芯片機箱交換機”,并指出“阿里云在運營數據中心網絡的長期經驗表明,多芯片機箱交換機比單芯片交換機帶來更多的穩定性風險。”

據透露,該公司的單芯片交換機數量是多芯片交換機的 32.6 倍。而這些多芯片交換機發生嚴重硬件故障的概率是單芯片交換機的 3.77 倍。

需要 DIY 散熱器

雖然阿里云推崇單芯片交換機,并且很享受其采用的 51.2Tbit/秒設備的吞吐量是之前設備的兩倍,同時功耗僅增加 45% 這一事實,但新款設備的運行溫度并不比之前的產品低。

如果芯片溫度超過 105°C,交換機可能會關閉。阿里云找不到能夠提供能夠將芯片溫度保持在 105°C 以下的冷卻系統的交換機供應商。因此它創建了自己的蒸汽室散熱器。

論文解釋道:“通過優化燈芯結構并在芯片中心部署更多的燈芯柱,熱量可以更有效地傳導。”

數據中心設計披露

以上所有設備都內置于每個容納 15,000 個 GPU 的“艙室”中,每個艙室都位于一個數據中心建筑內。

論文透露:“阿里云所有投入使用的數據中心建筑的總功率約束為 18MW,而一棟 18MW 的建筑可容納約 15K 個 GPU”,并補充道,“與 HPN 結合,每棟建筑都可以完美容納整個 Pod,從而在同一棟建筑內形成主要的鏈接。”

大樓內的所有光纖長度均在100米以內,從而可以“使用成本較低的多模光纖收發器(與單模光纖收發器相比,成本降低70%)。”

但事情并非全是美好的:論文承認“HPN 引入了額外的設計……使得布線變得更加復雜。”

“特別是在構建 HPN 的初期,現場工作人員會犯很多接線錯誤。”這意味著需要進行額外的測試。

論文還指出,單個以太網芯片的轉發容量每兩年翻一番。因此,阿里云已經在“設計配備更高容量單芯片交換機的下一代網絡架構”。

“我們在下一代數據中心的土地建設規劃中,對單棟建筑的總功率約束進行了調整,以覆蓋更多的GPU,這樣新數據中心交付時,就可以直接配備102.4Tbit/sec的單片交換機和下一代HPN。”

論文還指出,訓練具有數千億個參數的 LLM“依賴于大規模分布式訓練集群,通常配備數千萬個 GPU”。

阿里云自己的 Qwen 模型有一個經過 1100 億個參數訓練的變體——這意味著它有大量使用 NPM 的 pod,以及數百萬個生產中的 GPU。隨著其模型和數據中心變得越來越大、越來越多,它還需要更多。