3 月 10 日消息,“稚暉君”創(chuàng)業(yè)項目智元機器人今日發(fā)布了首個通用具身基座模型 —— 智元啟元大模型(Genie Operator-1),它開創(chuàng)性地提出了 Vision-Language-Latent-Action(ViLLA)架構(gòu),該架構(gòu)由 VLM(多模態(tài)大模型)+ MoE(混合專家)組成,實現(xiàn)了可以利用人類視頻學習,完成小樣本快速泛化,降低了具身智能門檻,并成功部署到智元多款機器人本體。

2024 年底,智元推出了 AgiBot World,包含超過 100 萬條軌跡、涵蓋 217 個任務(wù)、涉及五大場景的大規(guī)模高質(zhì)量真機數(shù)據(jù)集。基于 AgiBot World,智元今天正式發(fā)布智元通用具身基座大模型 Genie Operator-1(GO-1)。

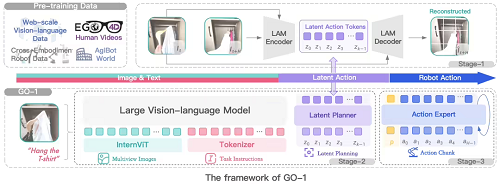

它開創(chuàng)性地提出了 Vision-Language-Latent-Action(ViLLA)架構(gòu),該架構(gòu)由 VLM(多模態(tài)大模型)+ MoE(混合專家)組成:

VLM 借助海量互聯(lián)網(wǎng)圖文數(shù)據(jù)獲得通用場景感知和語言理解能力

MoE 中的 Latent Planner(隱式規(guī)劃器)借助大量跨本體和人類操作視頻數(shù)據(jù)獲得通用的動作理解能力

MoE 中的 Action Expert(動作專家)借助百萬真機數(shù)據(jù)獲得精細的動作執(zhí)行能力

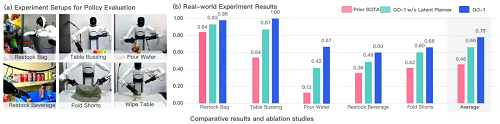

通過 ViLLA 架構(gòu),智元機器人在五種不同復雜度任務(wù)上測試 GO-1,相比已有的最優(yōu)模型,GO-1 成功率大幅領(lǐng)先,平均成功率提高了 32%(46%->78%)。其中“Pour Water”(倒水)、“Table Bussing”(清理桌面)和“Restock Beverage”(補充飲料)任務(wù)表現(xiàn)尤為突出。

此外智元機器人還單獨驗證了 ViLLA 架構(gòu)中 Latent Planner 的作用,可以看到增加 Latent Planner 可以提升 12% 的成功率(66%->78%)。

GO-1 大模型借助人類和多種機器人數(shù)據(jù),可泛化應(yīng)用到各類的環(huán)境和物品中,快速適應(yīng)新任務(wù)、學習新技能。同時,它還支持部署到不同的機器人本體完成落地,并在實際的使用中持續(xù)不斷地快速進化。

這一系列的特點可以歸納為 4 個方面:

人類視頻學習:GO-1 大模型可以結(jié)合互聯(lián)網(wǎng)視頻和真實人類示范進行學習,增強模型對人類行為的理解,更好地為人類服務(wù)。

小樣本快速泛化:GO-1 大模型具有強大的泛化能力,能夠在極少數(shù)據(jù)甚至零樣本下泛化到新場景、新任務(wù),降低了具身模型的使用門檻,使得后訓練成本非常低。

一腦多形:GO-1 大模型是通用機器人策略模型,能夠在不同機器人形態(tài)之間遷移,快速適配到不同本體,群體升智。

持續(xù)進化:GO-1 大模型搭配智元一整套數(shù)據(jù)回流系統(tǒng),可以從實際執(zhí)行遇到的問題數(shù)據(jù)中持續(xù)進化學習,越用越聰明。

智元機器人還預告了下一代具身智能機器人產(chǎn)品,不過沒有透露推出時間。